Você consegue tornar a IA mais justa que um juiz? Jogue nosso jogo de algoritmo para tribunais

Quando criança, você desenvolve uma noção do que significa “justiça”. É um conceito que você aprende desde cedo, à medida que se adapta ao mundo ao seu redor. Algo parece justo ou não.

Mas, cada vez mais, algoritmos começaram a arbitrar a justiça para nós. Eles decidem quem vê anúncios de imóveis, quem é contratado ou demitido e até quem é preso. Consequentemente, as pessoas que os criam — engenheiros de software — estão sendo solicitadas a articular o que significa ser justo em seus códigos. É por isso que reguladores em todo o mundo agora se deparam com uma questão: como quantificar matematicamente a justiça?

Esta história tenta oferecer uma resposta. E para isso, precisamos da sua ajuda. Vamos analisar um algoritmo real, usado para decidir quem vai para a cadeia, e pedir que você ajuste seus diversos parâmetros para tornar os resultados mais justos. (Não se preocupe — isso não envolve analisar o código!)

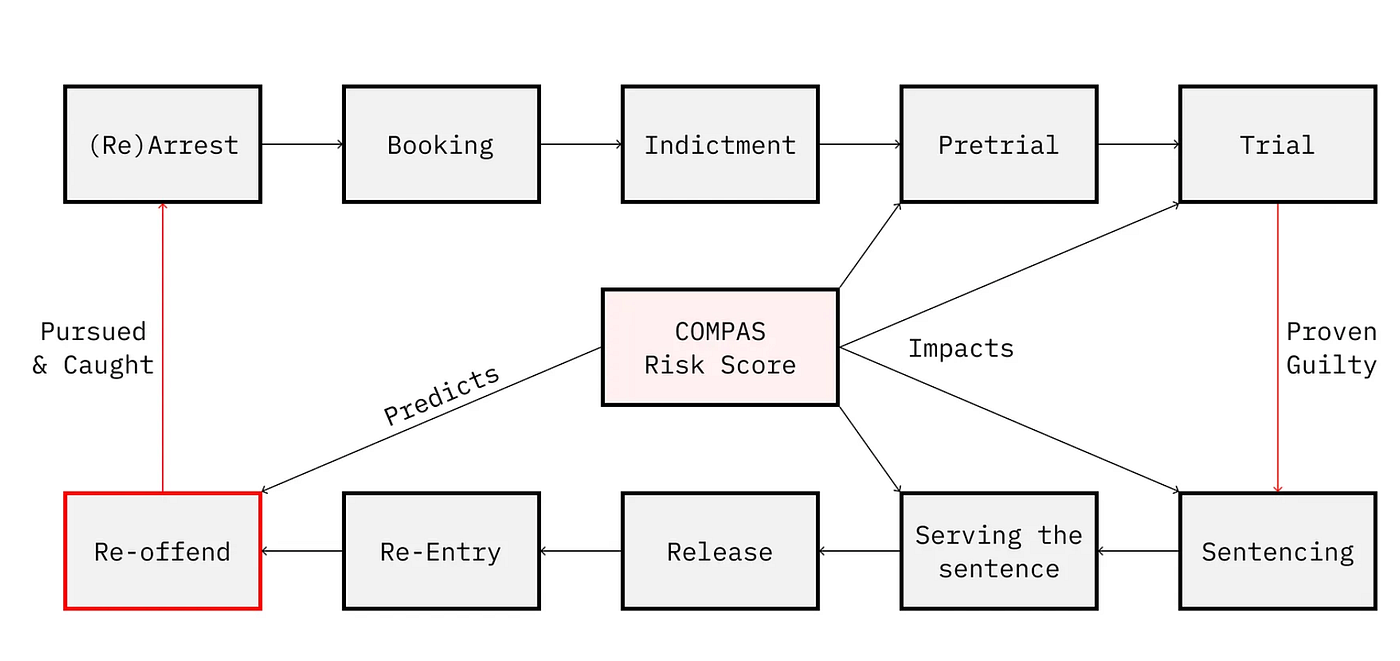

O algoritmo que estamos examinando é conhecido como COMPAS e é uma das várias ferramentas diferentes de “avaliação de risco” usadas no sistema jurídico criminal dos EUA.

Em um nível mais alto, o COMPAS deve ajudar os juízes a determinar se um réu deve ser mantido preso ou liberado enquanto aguarda o julgamento. Ele se baseia em dados históricos de réus para encontrar correlações entre fatores como a idade e o histórico de alguém com o sistema jurídico criminal, e se a pessoa foi ou não presa novamente. Em seguida, ele usa as correlações para prever a probabilidade de um réu ser preso por um novo crime durante o período de espera para o julgamento. 1

Prisões vs. condenações

Este processo é altamente imperfeito. As ferramentas usam prisões como um proxy para crimes, mas, na verdade, existem grandes discrepâncias entre os dois, pois a polícia tem um histórico de prender minorias raciais de forma desproporcional e de manipular dados. Além disso, novas prisões são frequentemente feitas por violações técnicas, como não comparecer ao tribunal, e não por reincidência. Nesta história, simplificamos demais para examinar o que aconteceria se as prisões correspondessem a crimes reais.

Essa previsão é conhecida como “pontuação de risco” do réu e serve como uma recomendação: réus de “alto risco” devem ser presos para evitar que causem danos potenciais à sociedade; réus de “baixo risco” devem ser soltos antes do julgamento. (Na realidade, os juízes nem sempre seguem essas recomendações, mas as avaliações de risco continuam sendo influentes.)

Os defensores das ferramentas de avaliação de risco argumentam que elas tornam o sistema jurídico penal mais justo. Elas substituem a intuição e o preconceito dos juízes — em particular, o preconceito racial — por uma avaliação aparentemente mais “objetiva”. Elas também podem substituir a prática de fiança nos EUA, que exige que os réus paguem uma quantia em dinheiro para serem soltos. A fiança discrimina os americanos pobres e afeta desproporcionalmente os réus negros, que estão sobrerrepresentados no sistema jurídico penal.

Metodologia da ProPublica

Para réus que foram presos antes do julgamento, a ProPublica analisou se eles foram presos novamente dentro de dois anos após a libertação. Em seguida, utilizou esse dado para estimar se os réus teriam sido presos novamente antes do julgamento se não tivessem sido presos.

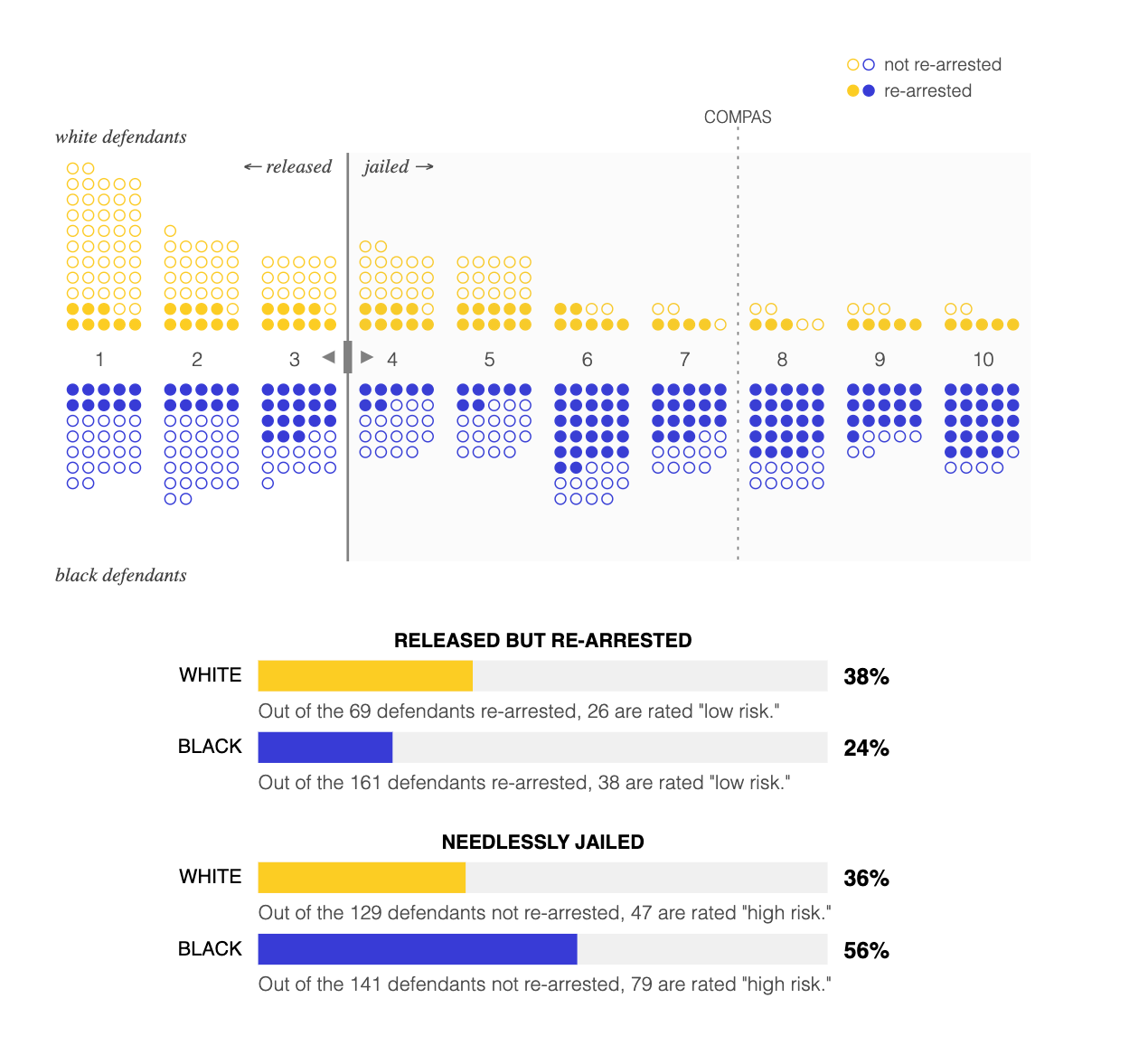

Conforme exigido por lei, o COMPAS não inclui a raça no cálculo de suas pontuações de risco. Em 2016, no entanto, uma investigação da ProPublica argumentou que a ferramenta ainda era tendenciosa contra negros. A ProPublica constatou que, entre os réus que nunca foram presos novamente, os réus negros tinham duas vezes mais probabilidade do que os brancos de terem sido classificados como de alto risco pelo COMPAS.

Então, nossa tarefa agora é tentar melhorar o COMPAS. Preparado?

Vamos começar com o mesmo conjunto de dados que a ProPublica utilizou em sua análise. Ele inclui todos os réus avaliados pelo algoritmo COMPAS no Condado de Broward, Flórida, de 2013 a 2014. No total, são mais de 7.200 perfis com o nome, idade, raça e pontuação de risco COMPAS de cada pessoa, além de indicar se a pessoa foi presa novamente após ser solta ou presa antes do julgamento.

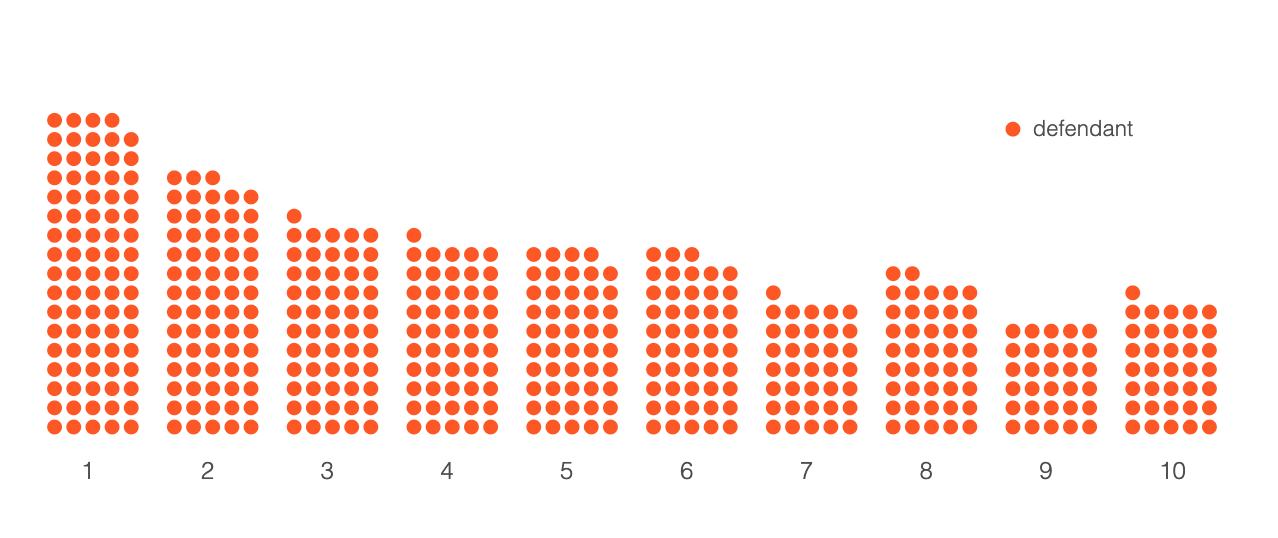

Para facilitar a visualização dos dados, selecionamos aleatoriamente 500 réus negros e brancos do conjunto completo.

Representamos cada réu como um ponto

Lembre-se: todos esses pontos representam pessoas acusadas (mas não condenadas) por um crime. Algumas serão presas antes do julgamento; outras serão liberadas imediatamente. Algumas serão presas novamente após a soltura; outras, não. Queremos comparar duas coisas: as previsões (quais réus receberam pontuações de risco “alto” vs. “baixo”) e os resultados reais (quais réus realmente foram presos novamente após serem soltos).

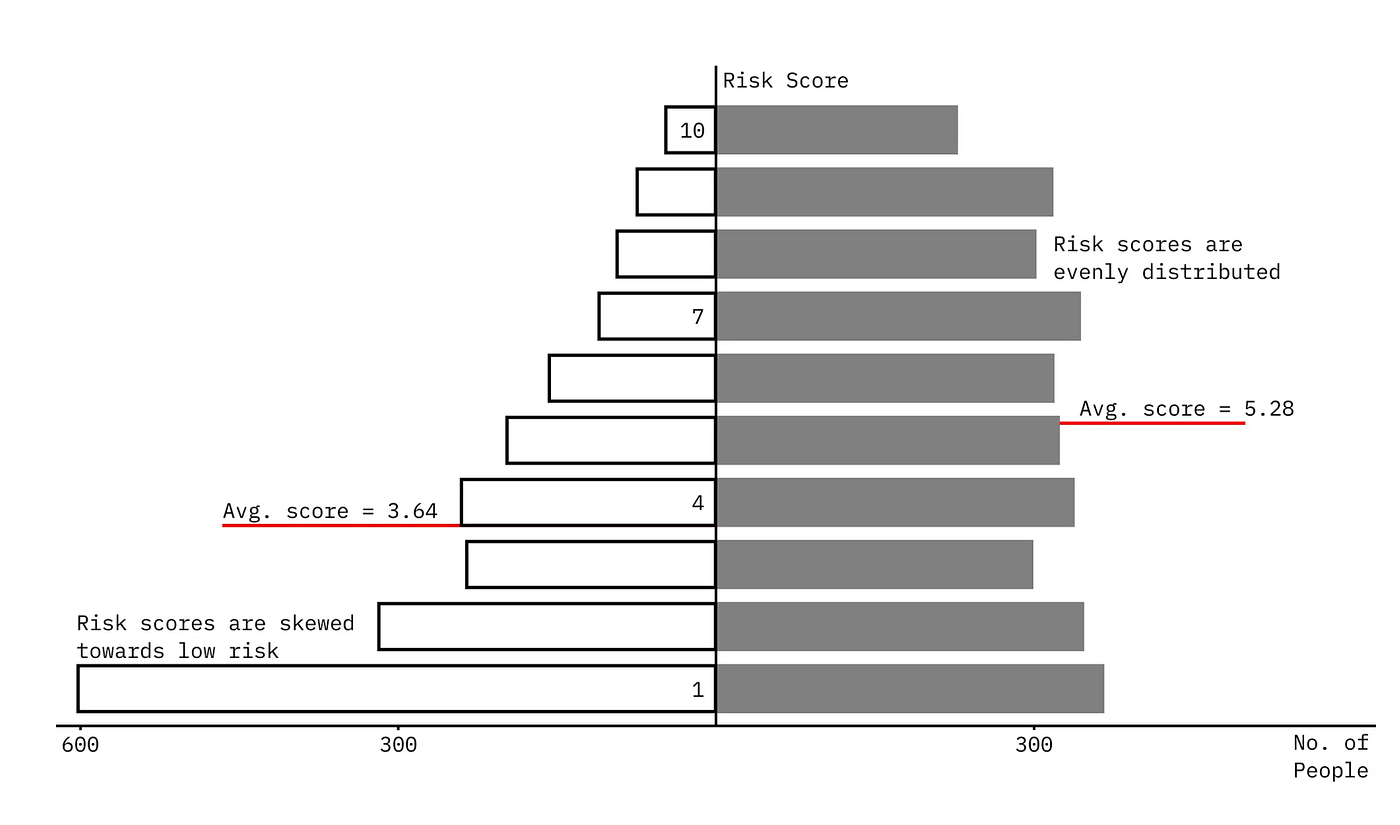

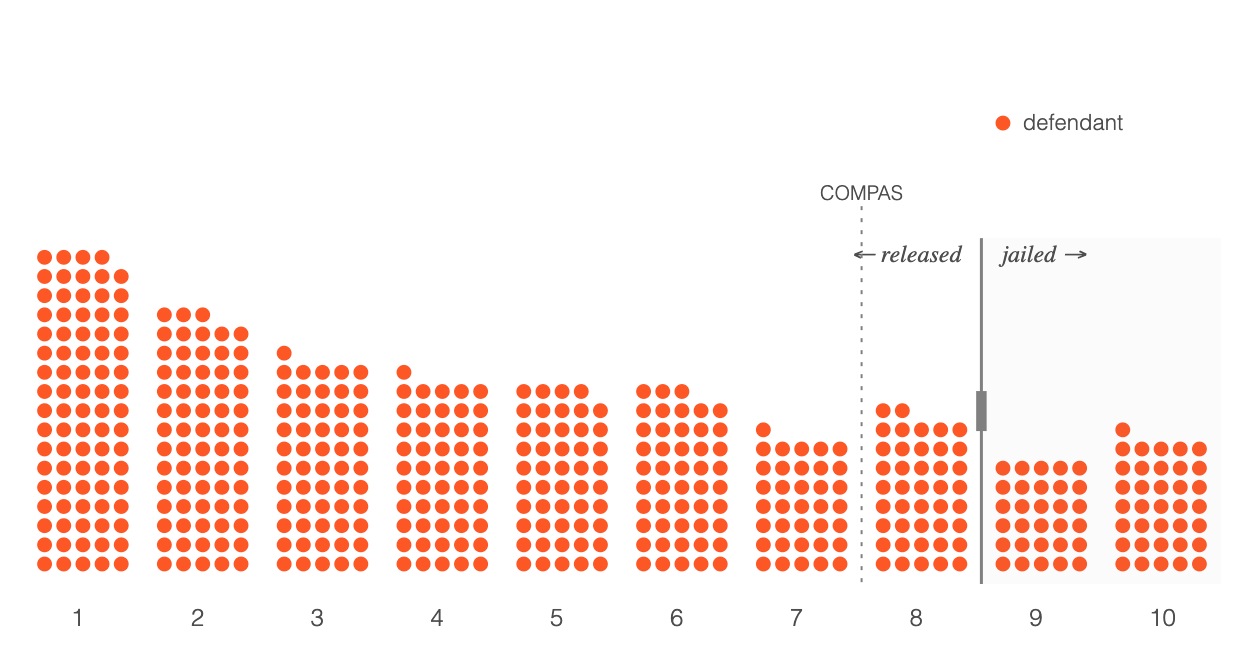

O COMPAS pontua os réus em uma escala de 1 a 10, onde 1 corresponde aproximadamente a 10% de chance de nova prisão, 2 a 20% e assim por diante.

Vamos ver como o COMPAS pontuou cada um.

O COMPAS foi projetado para fazer previsões agregadas sobre grupos de pessoas que compartilham características semelhantes, em vez de previsões sobre indivíduos específicos. A metodologia por trás de suas pontuações e as recomendações sobre como usá-las são mais complexas do que tínhamos espaço para apresentar; você pode ler sobre elas no link acima.

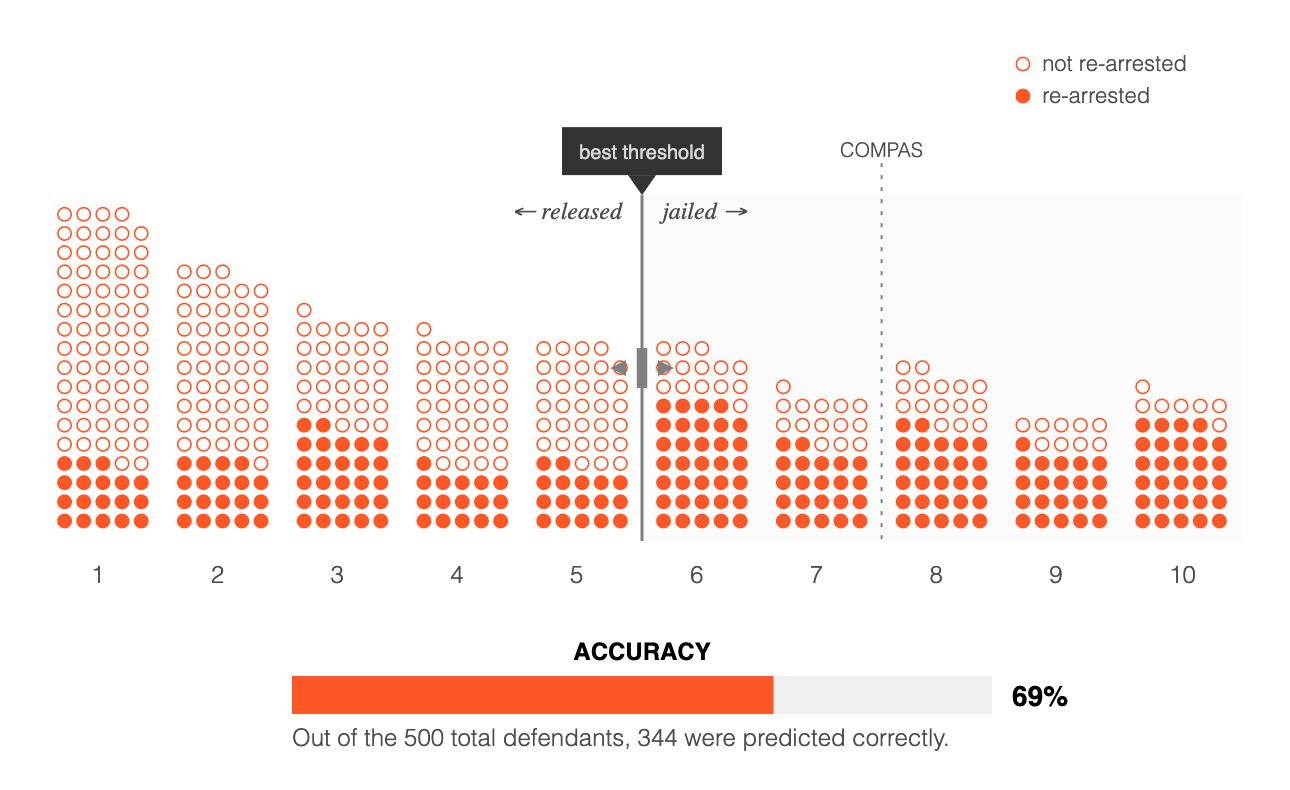

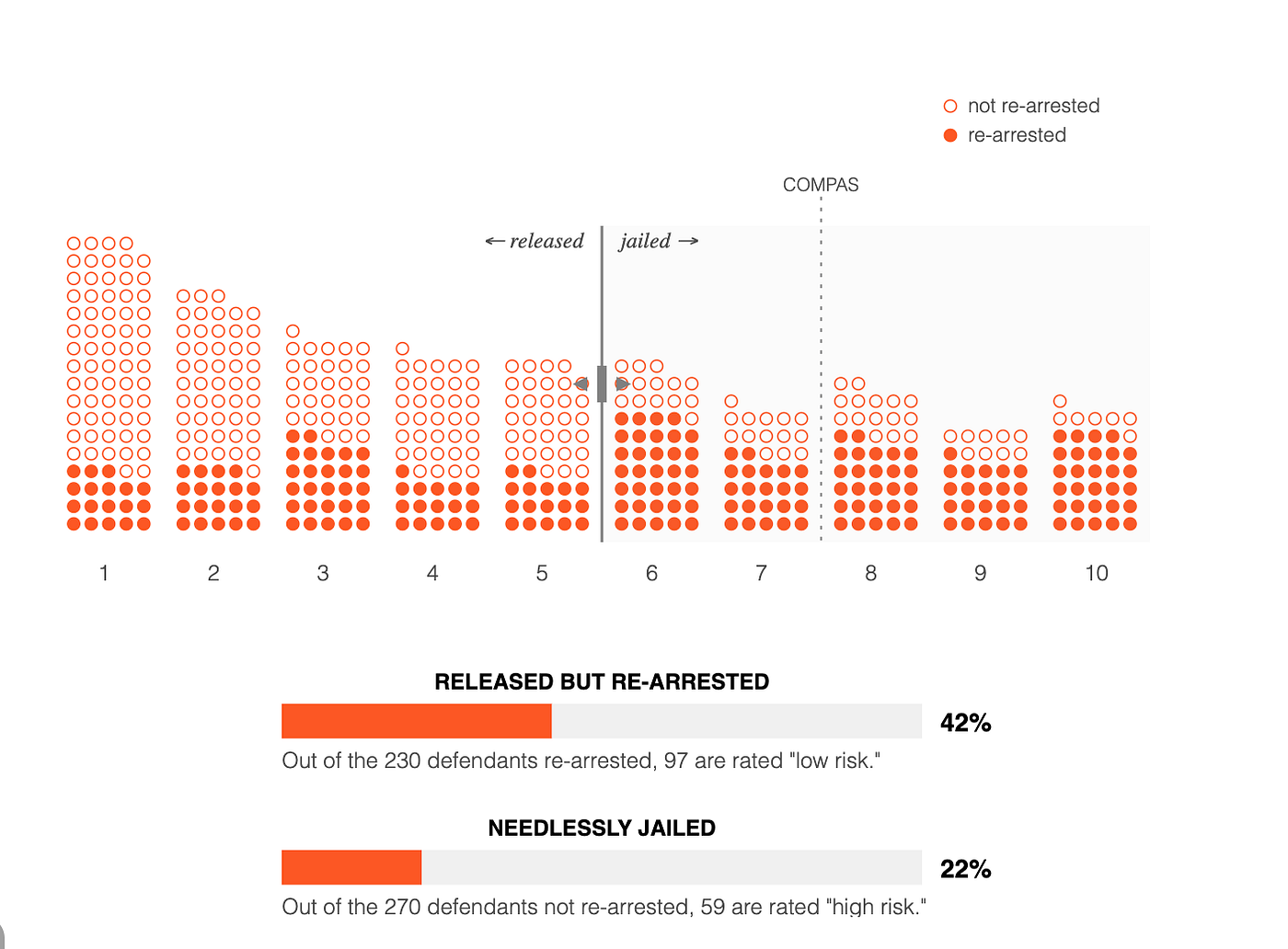

Embora o COMPAS possa oferecer apenas uma probabilidade estatística de que um réu seja preso novamente antes do julgamento, os juízes, é claro, precisam tomar uma decisão decisiva: libertar ou prender o réu. Para os propósitos desta matéria, usaremos o limite de “alto risco” do , uma pontuação de 7 ou superior, para representar uma recomendação de que um réu seja preso.

A partir de agora, você está no comando. Sua missão é redesenhar a última etapa deste algoritmo, encontrando um lugar mais justo para definir o limite de “alto risco”.

É assim que seu limite ficará. Tente clicar nele e arrastá-lo.

Então, primeiro, vamos imaginar o melhor cenário possível: todos os réus que o seu algoritmo classifica com uma pontuação de alto risco são presos novamente, e todos os réus que recebem uma pontuação de baixo risco não são presos novamente. Abaixo, nosso gráfico mostra como isso pode ser. Os círculos preenchidos são os réus que foram presos novamente; os círculos vazios são aqueles que não foram.

Agora mova o limite para tornar seu algoritmo o mais justo possível.

Em outro cenário

(Em outras palavras, somente réus presos novamente devem ser presos.)

Ótimo! Essa foi fácil. Seu limite deve ser definido entre 6 e 7. Ninguém foi detido desnecessariamente, e ninguém que foi solto foi preso novamente.

Mas é claro que esse cenário ideal nunca acontece de fato. É impossível prever perfeitamente o resultado para cada pessoa. Isso significa que os pontos preenchidos e vazios não podem ser separados tão nitidamente.

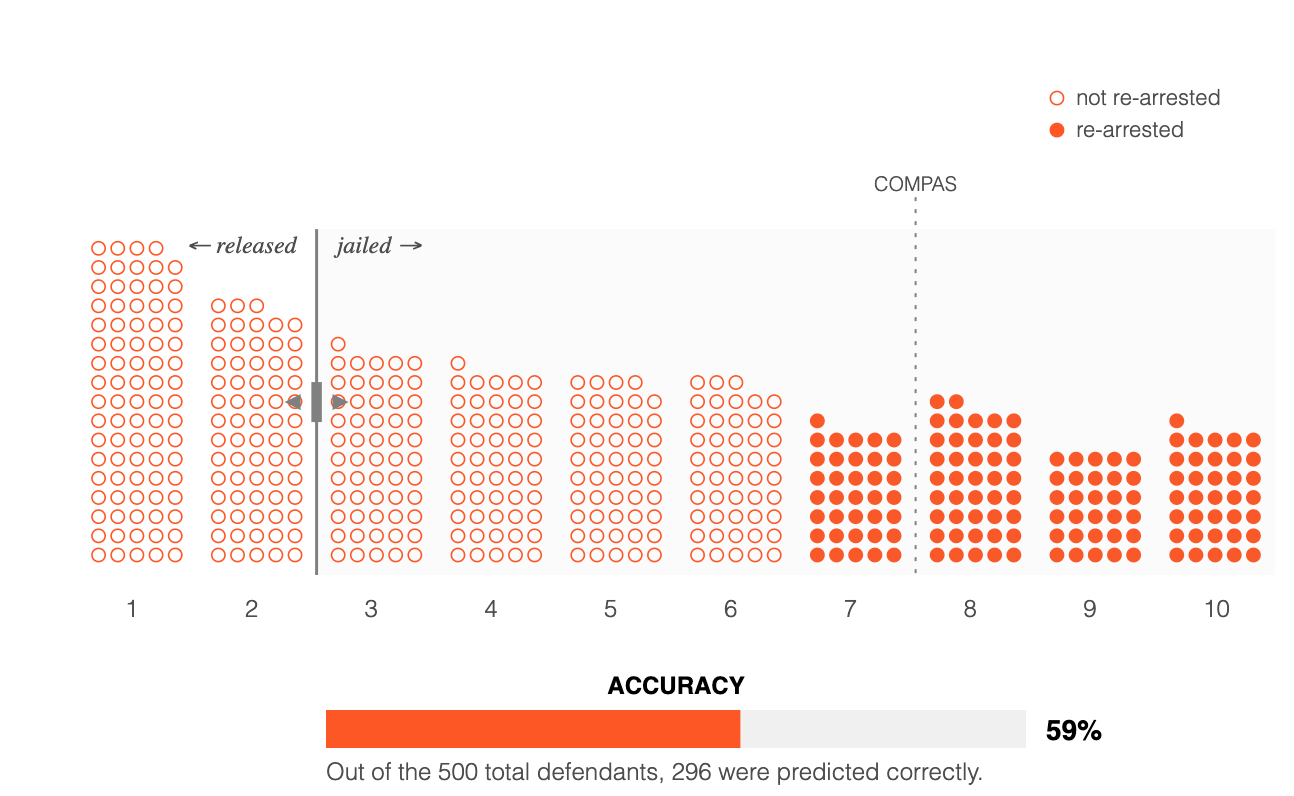

Então aqui está quem realmente foi preso novamente.

Agora mova o limite novamente para tornar seu algoritmo o mais justo possível.

(Dica: você quer maximizar sua precisão.)

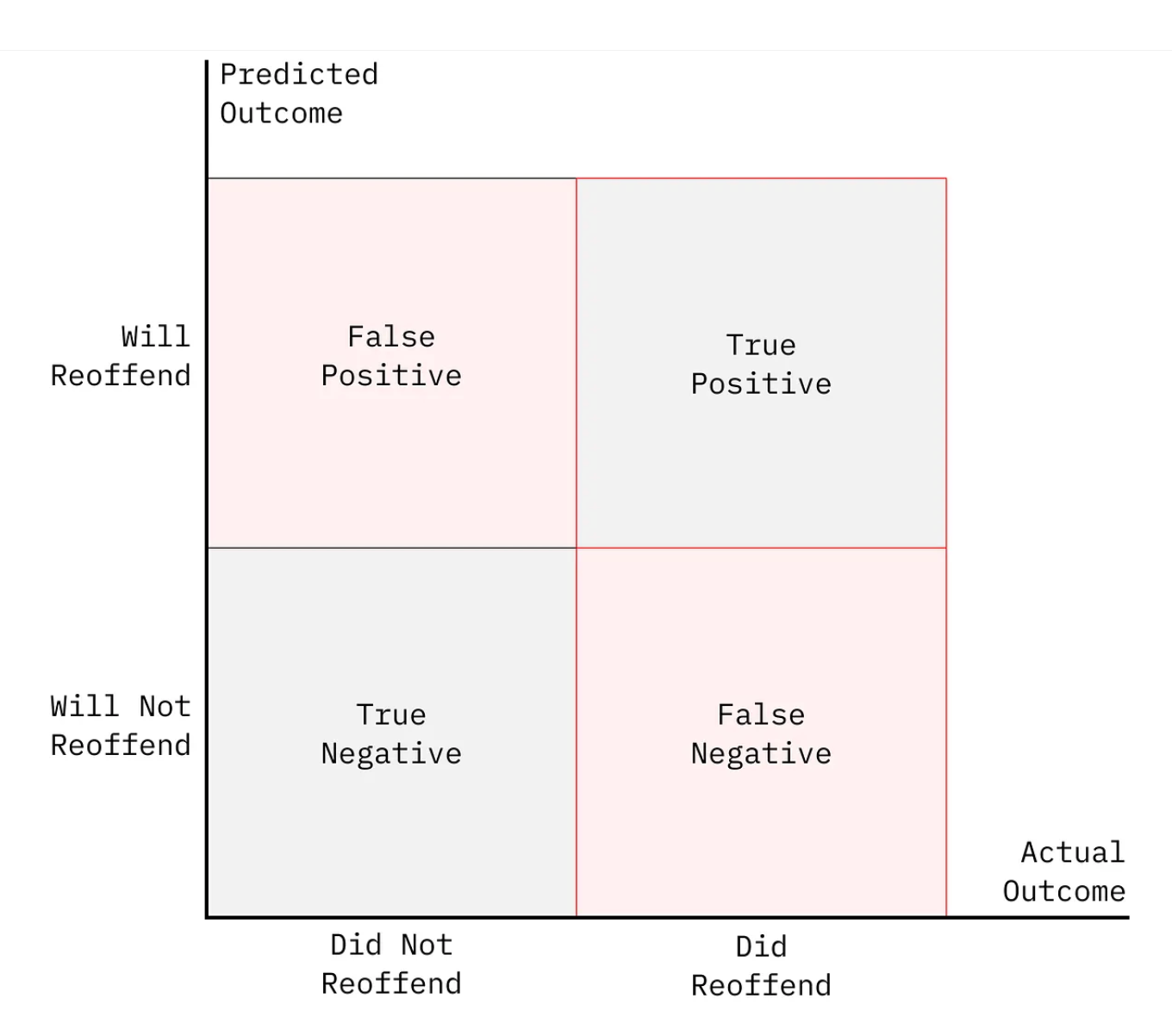

Você notará que, independentemente de onde você coloque o limite, ele nunca é perfeito: sempre prendemos alguns réus que não são presos novamente (pontos vazios à direita do limite) e soltamos alguns réus que são presos novamente (pontos preenchidos à esquerda do limite). Essa é uma compensação com a qual nosso sistema jurídico criminal sempre lidou, e não é diferente quando usamos um algoritmo.

Para tornar essas compensações mais claras, vamos analisar a porcentagem de previsões incorretas que o COMPAS faz em cada lado do limite, em vez de apenas medir a precisão geral. Agora, poderemos ver explicitamente se nosso limite favorece a manutenção desnecessária de pessoas na prisão ou a libertação de pessoas que serão presas novamente. 4 Observe que o limite padrão do COMPAS favorece a última opção.

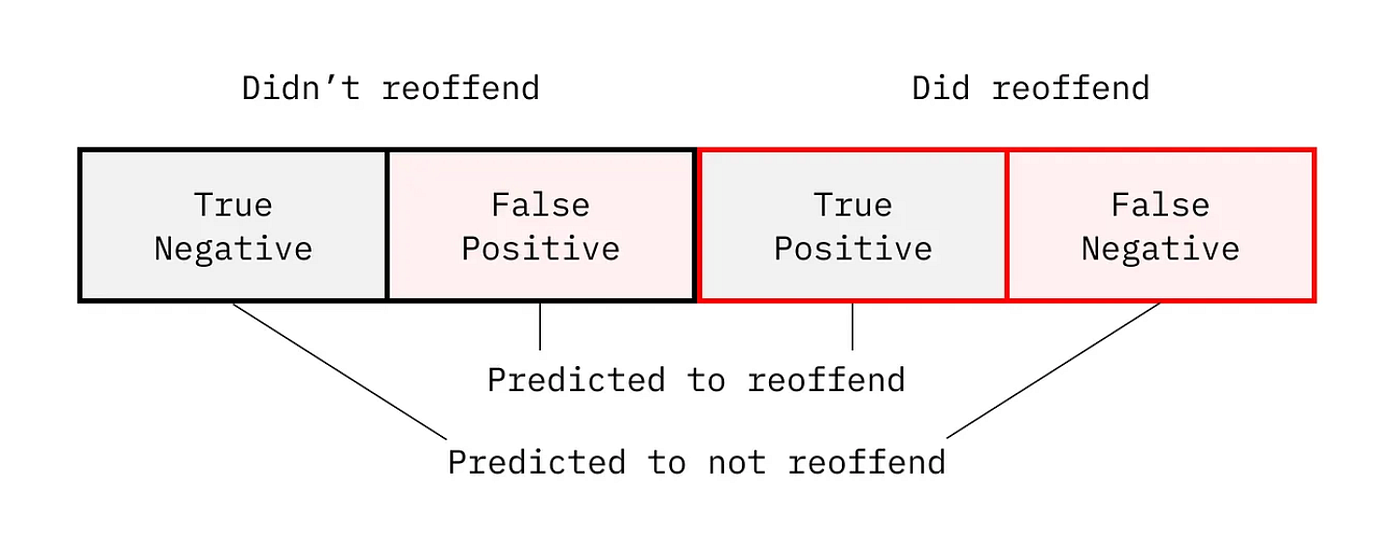

Essas duas porcentagens de erro também são conhecidas como “taxa de falsos negativos” (que chamamos de “liberados, mas presos novamente”) e “taxa de falsos positivos” (que chamamos de “presos desnecessariamente”).

Como devemos equilibrar essa compensação de forma justa? Não há uma resposta universal, mas na década de 1760, o juiz inglês William Blackstone escreveu: “É melhor que dez culpados escapem do que um inocente sofra”.

A proporção de Blackstone ainda é altamente influente nos EUA hoje. Então, vamos usá-la como inspiração.

Aumentar o limite para onde a percentagem de “libertados mas presos novamente” seja aproximadamente 10 vezes superior à percentagem de “presos desnecessariamente”.

Você já pode perceber dois problemas ao usar um algoritmo como o COMPAS. O primeiro é que uma previsão melhor pode sempre ajudar a reduzir as taxas de erro em geral, mas nunca pode eliminá-las completamente. Não importa quantos dados coletemos, duas pessoas que parecem iguais para o algoritmo sempre podem acabar fazendo escolhas diferentes.

O segundo problema é que, mesmo seguindo as recomendações do COMPAS consistentemente, alguém — um ser humano — precisa primeiro decidir onde o limite de “alto risco” deve se situar, seja usando o índice de Blackstone ou outro método. Isso depende de todos os tipos de considerações — políticas, econômicas e sociais.

Agora, chegaremos a um terceiro problema. É aqui que nossas explorações sobre justiça começam a ficar interessantes. Como as taxas de erro se comparam entre diferentes grupos? Existem certos tipos de pessoas com maior probabilidade de serem detidas desnecessariamente?

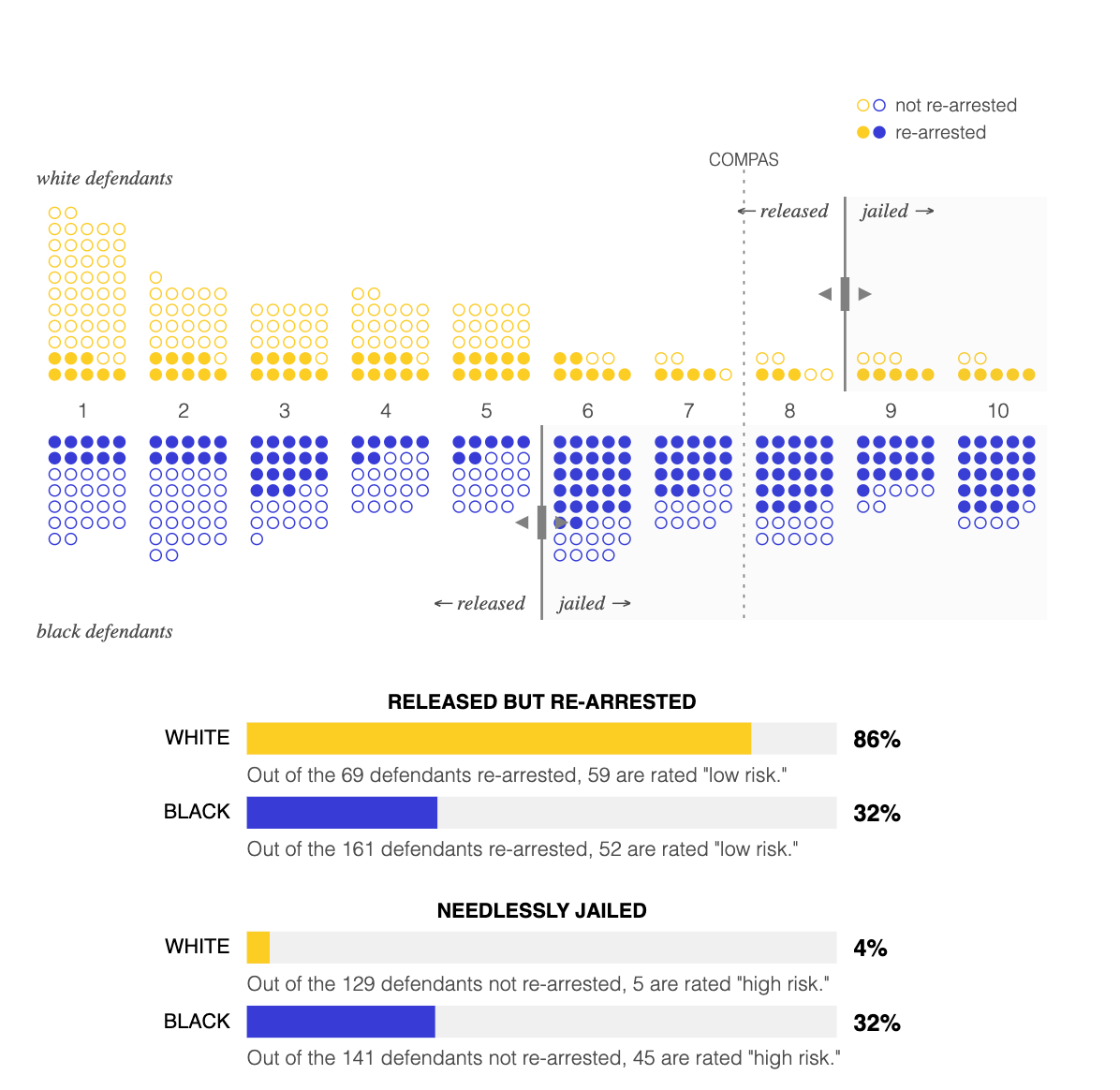

Vamos ver como ficam nossos dados quando consideramos a raça dos réus.

Agora mova cada limite para ver como ele afeta réus negros e brancos de forma diferente.

Raça é um exemplo de classe protegida nos EUA, o que significa que a discriminação com base nessa classificação é ilegal. Outras classes protegidas incluem gênero, idade e deficiência.

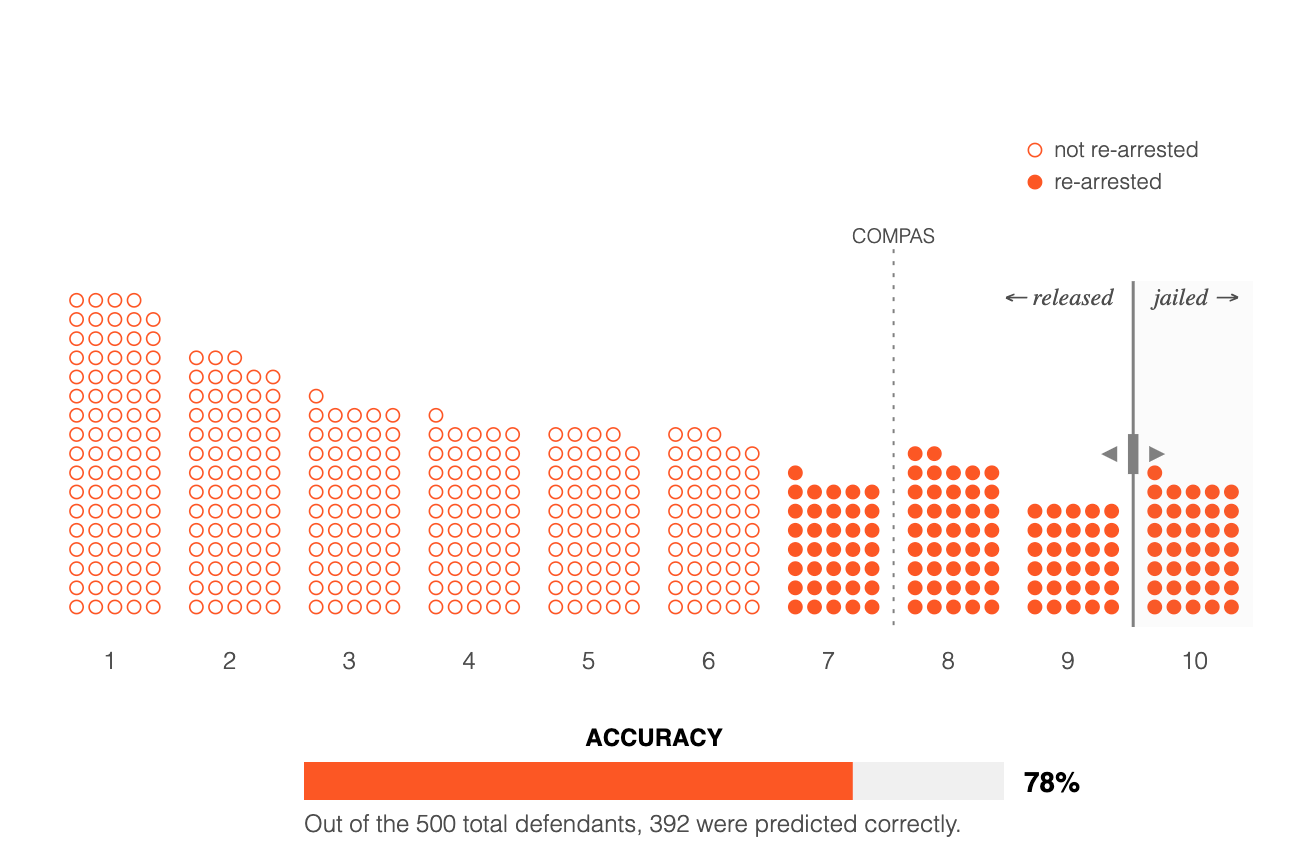

Agora que separamos os réus negros dos brancos, descobrimos que, embora a raça não seja usada para calcular as pontuações de risco do COMPAS, as pontuações apresentam taxas de erro diferentes para os dois grupos.

No limite padrão do COMPAS, entre 7 e 8, 16% dos réus negros que não são presos novamente foram presos desnecessariamente, enquanto o mesmo se aplica a apenas 7% dos réus brancos. Isso não parece nada justo! É exatamente isso que a ProPublica destacou em sua investigação.

Certo, então vamos consertar isso.

Mova cada limite para que réus brancos e negros sejam presos desnecessariamente na mesma proporção.

(Há várias soluções. Nós escolhemos uma, mas você pode tentar encontrar outras.)

Tentamos alcançar a proporção de Blackstone novamente, então chegamos à seguinte solução: réus brancos têm um limite entre 6 e 7, enquanto réus negros têm um limite entre 8 e 9. Agora, cerca de 9% dos réus negros e brancos que não são presos novamente são presos desnecessariamente, enquanto 75% dos que são são presos novamente sem passar nenhum tempo na prisão. Bom trabalho! Seu algoritmo parece muito mais justo do que o COMPAS agora.

Mas espere — será mesmo?

No processo de comparação das taxas de erro entre raças, perdemos algo importante: nossos limites para cada grupo estão em posições diferentes, então nossas pontuações de risco significam coisas diferentes para réus brancos e negros.

Réus brancos são presos por uma pontuação de risco de 7, mas réus negros são soltos pela mesma pontuação. Isso, mais uma vez, não parece justo. Duas pessoas com a mesma pontuação de risco têm a mesma probabilidade de serem presas novamente, então não deveriam receber o mesmo tratamento?

Nos EUA, usar limites diferentes para raças diferentes também pode levantar questões jurídicas complexas com a 14ª Emenda, a cláusula de proteção igualitária da Constituição.

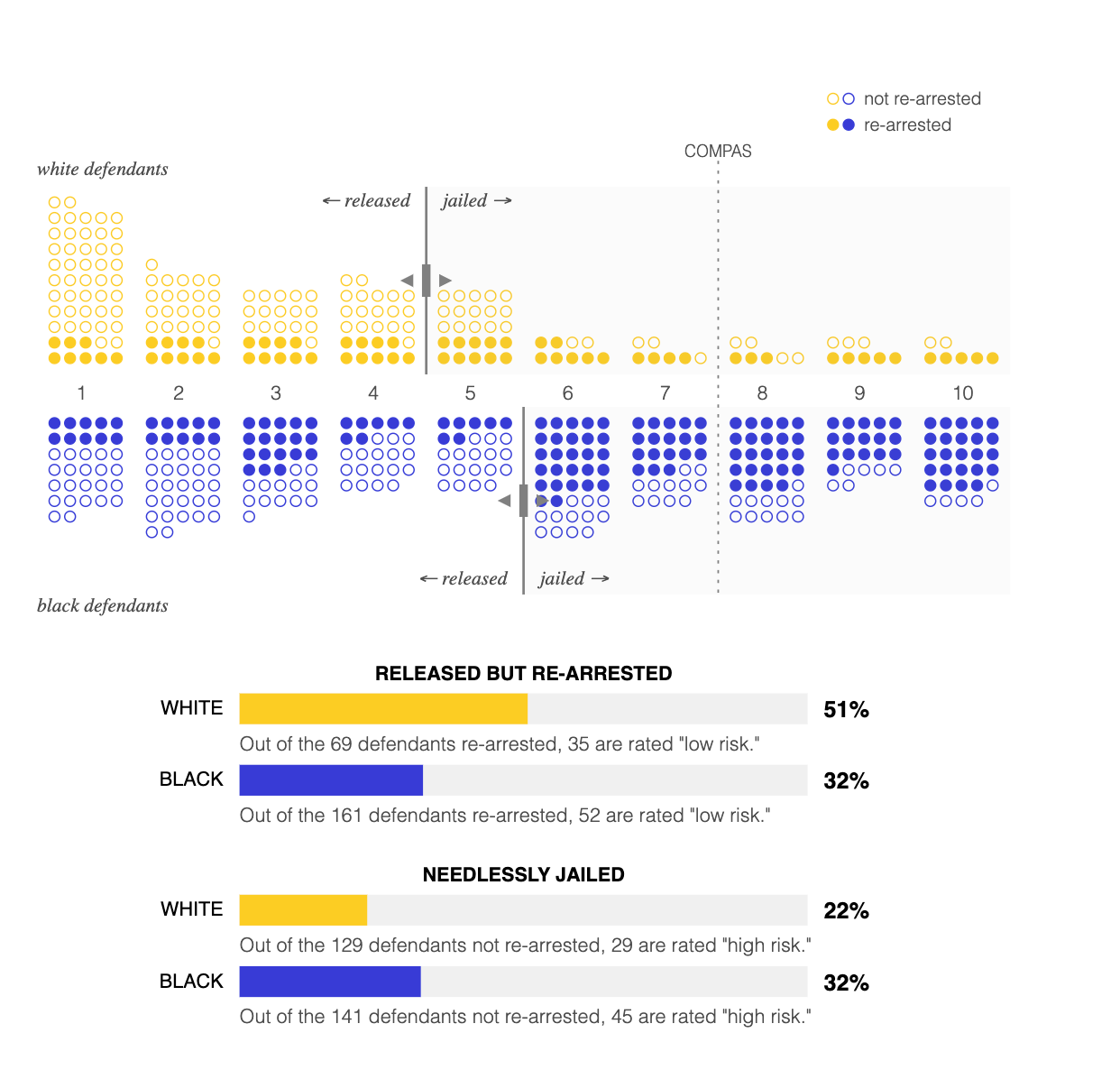

Então, vamos tentar mais uma vez com um único limite compartilhado entre ambos os grupos.

Mova o limite novamente para que réus brancos e negros sejam presos desnecessariamente na mesma proporção.

Se você está ficando frustrado, há um bom motivo. Não há solução.

Apresentamos duas definições de justiça: manter as taxas de erro comparáveis entre os grupos e tratar pessoas com as mesmas pontuações de risco da mesma forma. Ambas as definições são totalmente defensáveis! Mas satisfazer ambas ao mesmo tempo é impossível.

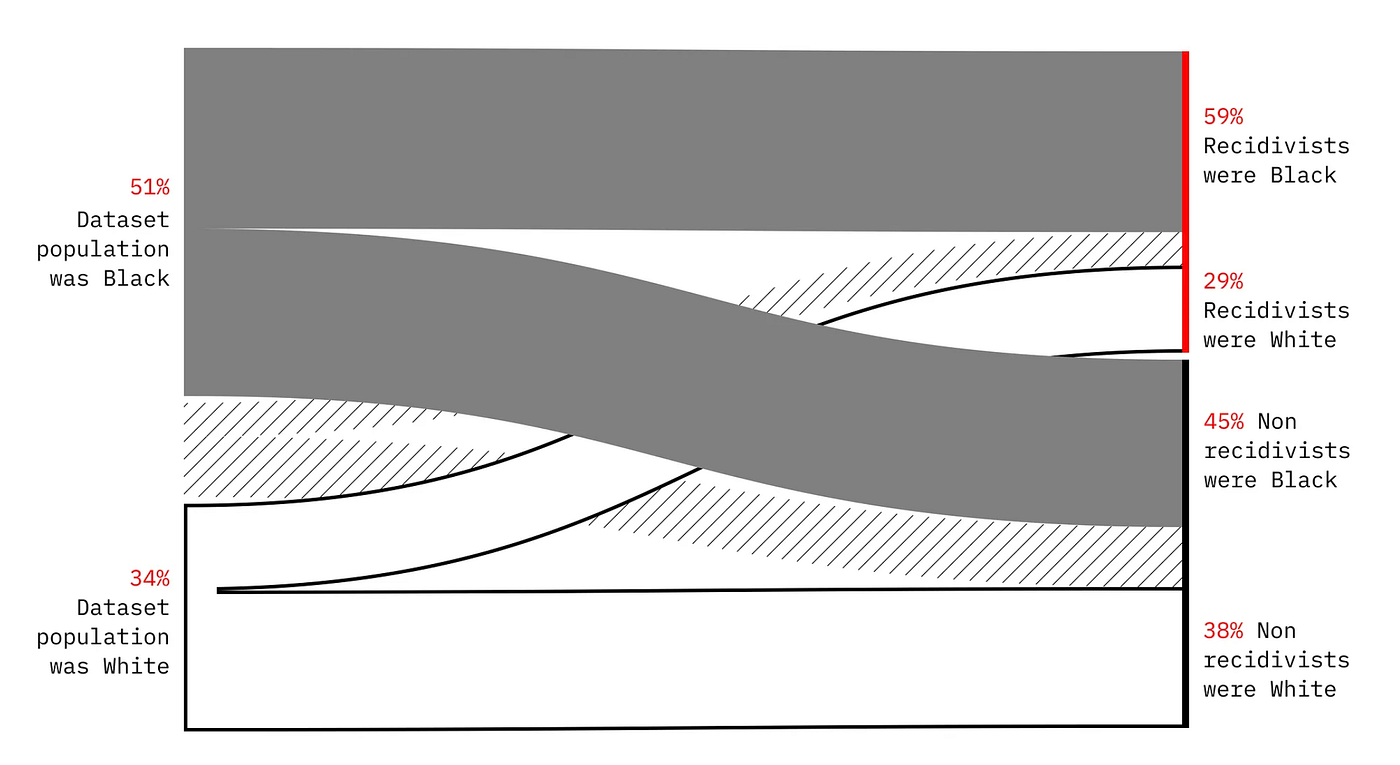

A razão é que réus negros e brancos são presos novamente em taxas diferentes. Enquanto 52% dos réus negros foram presos novamente em nossos dados do Condado de Broward, apenas 39% dos réus brancos o foram. Há uma diferença semelhante em muitas jurisdições nos EUA, em parte devido ao histórico do país de a polícia visar desproporcionalmente minorias (como mencionamos anteriormente).

As previsões refletem os dados utilizados para criá-las — sejam elas por algoritmo ou não. Se réus negros forem presos em uma taxa maior do que réus brancos no mundo real, eles também terão uma taxa de previsão de prisão maior. Isso significa que eles também terão pontuações de risco mais altas, em média, e uma porcentagem maior deles será rotulada como de alto risco — tanto correta quanto incorretamente .

Isso é verdade independentemente do algoritmo utilizado, desde que seja projetado de forma que cada pontuação de risco signifique a mesma coisa, independentemente da raça.

Esse estranho conflito de definições de justiça não se limita apenas aos algoritmos de avaliação de risco no sistema jurídico criminal. Os mesmos tipos de paradoxos se aplicam a algoritmos de pontuação de crédito, seguros e contratação.

Em qualquer contexto em que um sistema automatizado de tomada de decisão precise alocar recursos ou punições entre vários grupos com resultados diferentes, diferentes definições de justiça inevitavelmente se tornarão mutuamente exclusivas.

Não existe algoritmo que possa consertar isso; na verdade, isso nem sequer é um problema algorítmico . Juízes humanos estão atualmente fazendo o mesmo tipo de escolha forçada — e têm feito isso ao longo da história.

Mas eis o que um algoritmo mudou . Embora os juízes nem sempre sejam transparentes sobre como escolhem entre diferentes noções de justiça, as pessoas podem contestar suas decisões. Em contraste, o COMPAS, produzido pela empresa privada

Northpointe, é um segredo comercial que não pode ser revisado ou questionado publicamente. Os réus não podem mais questionar seus resultados, e as agências governamentais perdem a capacidade de escrutinar o processo de tomada de decisão. Não há mais responsabilização pública.

Então, o que os reguladores devem fazer? A proposta de Lei de Responsabilidade Algorítmica de 2019 é um exemplo de um bom começo, afirma Andrew Selbst, professor de direito da Universidade da Califórnia, especializado em IA e direito.

O projeto de lei, que busca regular o viés em sistemas automatizados de tomada de decisão, tem duas características notáveis que servem de modelo para futuras legislações. Primeiro, exigiria que as empresas auditassem seus sistemas de aprendizado de máquina em busca de viés e discriminação em uma “avaliação de impacto”. Segundo, não especifica uma definição de justiça.

“Com uma avaliação de impacto, você está sendo muito transparente sobre como você, como empresa, está abordando a questão da justiça”, diz Selbst. Isso traz a responsabilidade pública de volta ao debate. Como “justiça significa coisas diferentes em contextos diferentes”, acrescenta, evitar uma definição específica permite essa flexibilidade.

Mas se algoritmos devem ser usados para arbitrar a justiça em primeiro lugar é uma questão complexa. Algoritmos de aprendizado de máquina são treinados com base em “dados produzidos por meio de históricos de exclusão e discriminação”, escreve Ruha Benjamin, professora associada da Universidade de Princeton, em seu livro “ Race After Technology” .

Ferramentas de avaliação de risco não são diferentes. A questão mais importante sobre seu uso — ou de quaisquer algoritmos usados para classificar pessoas — é se eles reduzem as desigualdades existentes ou as agravam.

Selbst recomenda proceder com cautela: “Sempre que transformamos noções filosóficas de justiça em expressões matemáticas, elas perdem sua nuance, sua flexibilidade, sua maleabilidade”, diz ele. “Isso não quer dizer que algumas das vantagens de fazer isso não valham a pena. Só tenho minhas dúvidas.”

De onde vem a diferença nas taxas reais de reincidência?

Os negros americanos têm mais probabilidade de serem parados, presos e encarcerados.

Justo?